안녕하세요! 디지털맨땅이입니다.

AI가 언어를 배우고 이미지를 만들어내던 시절은 지나갔습니다.

이제는 사람의 손을 흉내 내기 시작했습니다.

무슨 말이냐고요?

구글 딥마인드가 이번에 공개한 Gemini 2.5 Computer Use 모델은 단순히 말로 대답하는 인공지능이 아닙니다.

화면을 보고, 버튼을 누르고, 입력창에 글을 쓰는 말 그대로 직접 행동하는 AI입니다.

저도 처음엔 그냥 자동 클릭 정도만 가능하지 않을까? 싶었는데, 데모를 보고 나니 확실히 감이 오더라고요.

이건 코드나 API가 아니라, 사람의 브라우저를 대신 조작하는 인공지능이었습니다.

오늘은 Gemini 2.5 Computer Use 모델에 대해서 소개해드릴게요!

1. 모델 개요 – Gemini 2.5 Pro 기반의 확장판

Computer Use 모델은 Gemini 2.5 Pro LLM을 기반으로 만들어졌습니다.

구글 딥마인드는 이 모델을 통해 기존의 AI Mode나 Project Mariner 같은 초기형 에이전트 실험을 정식화했습니다.

예전부터 여러 방식으로 시험해왔는데, 이번에 정식 모델로 발표했다고 이해하시면 될 것 같아요.

즉, 이번 모델은 완성된 행동형 AI의 첫 버전이라 볼 수 있습니다.

이 모델의 목적은 다음과 같습니다.

언어모델이 텍스트만 다루던 한계를 넘어, 실제 소프트웨어 환경에서 사람처럼 일하게 만든다.

이를 위해 모델은 시각 이해(Visual Understanding)와 추론(Reasoning)을 결합했습니다.

① 사용자의 요청을 해석하고,

② 웹페이지의 구조를 인식한 뒤,

③ 그에 맞는 행동을 AI가 직접 수행하는 것입니다.

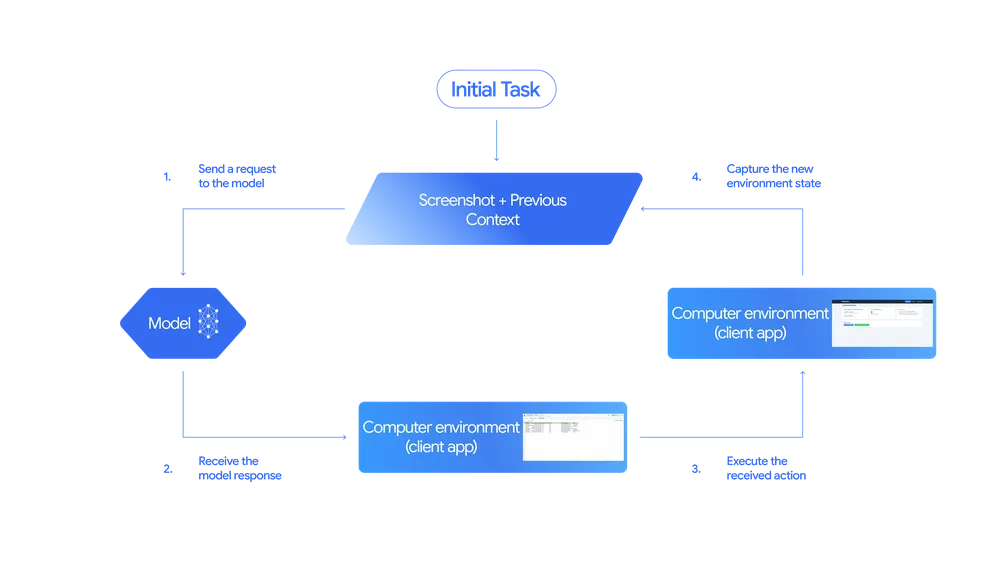

2. 동작 구조 – 루프(Loop)형 제어 프로세스

Computer Use의 가장 핵심적인 구조는 루프 기반 실행 흐름입니다.

각 요청은 아래와 같은 사이클로 처리됩니다.

① 사용자가 요청을 보낸다. (예: 이 사이트에서 반려동물 스파 예약해줘.)

② 모델은 현재 웹페이지의 스크린샷과 직전 행동 기록을 입력받는다.

③ 이를 분석한 뒤, 다음 행동을 예측한다. (예: 클릭, 입력, 드롭다운 선택, 스크롤 등)

④ 그 행동을 실제 브라우저에서 실행한다.

⑤ 실행 후 새 스크린샷과 URL이 다시 모델로 전달되어, 결과를 검토하고 다음 행동을 결정한다.

이 과정을 반복하면서 모델은 하나의 업무를 완성합니다.

즉, 인식 → 판단 → 행동 → 피드백 → 재행동 구조의 완전한 루프형 에이전트입니다.

어떤 방식인지 아직 감이 안오신다면, 아래의 '실제 시연 예시'를 참고해주시면 좋을 것 같아요.

딥마인드는 이를 Computer Use Loop라고 부르며,

이 프로세스를 통해 API가 없는 웹 환경도 제어할 수 있는 범용 AI를 지향한다고 설명했습니다.

출처: Google DeepMind 공식 블로그 / SiliconANGLE (2025.10.07)

Introducing the Gemini 2.5 Computer Use Model

3. 실제 시연 예시 – 사람처럼 일하는 AI

공개된 데모는 매우 구체적이었습니다.

첫 번째 시연은 다음과 같았습니다.

“https://tinyurl.com/pet-care-signup 에서

캘리포니아 거주 반려동물 정보를 가져오고,

이를 https://pet-luxe-spa.web.app/ 의 스파 CRM에 게스트로 등록하라.

이후 10월 10일 오전 8시 이후로 Anima Lavar와 후속 방문 예약을 잡아라.”

이 한 문장을 입력하자 AI가 웹페이지를 탐색하고,

양식을 작성하고, 버튼을 클릭해 예약을 완료했습니다.

사람이 마우스로 클릭하던 흐름을 그대로 재현한 것입니다.

또 다른 시연에서는 협업보드 sticky-note-jam.web.app에 접속해 포스트잇 메모들을 제자리로 옮기고 정리했습니다.

AI가 포스트잇트의 위치를 인식하고, 드래그로 재배치하는 장면은

이 모델이 단순한 언어모델이 아니라 시각 피드백을 처리하는 행위자(Agent)임을 보여줍니다.

4. 성능 벤치마크 – 정확도와 속도 모두 잡았다

딥마인드는 Computer Use가 Online-Mind2Web, WebVoyager, AndroidWorld 등

주요 벤치마크에서 정확도 70% 이상, 평균 지연시간 225초 내외를 기록했다고 밝혔습니다.

특히 Browserbase 환경에서 가장 낮은 레이턴시(latency)를 보였다고 합니다.

이렇게 말씀드리면 무슨 의미인지 너무 어렵죠...?ㅎㅎ 간단하게 설명드리자면!

동일 정확도 대비 응답 지연 시간이 가장 짧았다는 의미로

이는 단순히 빠르다는 뜻이 아니라, 정확도를 유지하면서 반응 속도까지 개선했다는 의미입니다.

즉, 다른 모델보다 정확하면서도 빠른 브라우저 조작이 가능하다는 거죠.

흥미롭게도 AndroidWorld 테스트에서도 높은 점수를 기록해 웹뿐 아니라 모바일 UI 제어 가능성도 입증했습니다.

아직 13개의 행동(Action)만 지원하지만, 딥마인드는 향후 모바일 환경으로도 확장하겠다고 예고했습니다.

5. 안전 장치 – 무단 조작을 막는 3단계 시스템

AI가 실제로 웹을 조작할 수 있다는 건 동시에 보안 리스크도 큽니다.

딥마인드는 이를 위해 세 가지 방어 체계를 설계했습니다.

① Per-step Safety Service:

모델이 수행하려는 행동을 매 단계마다 검증하는 별도 서비스.

② System Instructions:

결제·로그인·삭제 같은 민감한 액션은 반드시 사용자 승인 필요.

③ Prompt Injection 차단:

악성 프롬프트나 자동 클릭 유도 스크립트를 탐지해 실행 전 차단.

즉, 무단 결제나 스팸성 자동화는 구조적으로 불가능하게 설계된 셈입니다.

6. 경쟁 구도 – OpenAI, Anthropic과의 차이점

기사에 따르면 구글은 사실 이 분야에서 조금 늦은 후발주자입니다.

- OpenAI는 전날 ChatGPT Agent 업데이트로 이미 컴퓨터 조작형 AI 기능을 시연했습니다.

- Anthropic은 2024년에 Claude 모델에 Computer Use 기능을 넣었죠.

하지만 구글의 전략은 명확하게 다릅니다.

운영체제(OS) 전체 제어가 아닌, 브라우저 중심 제어에 집중했다는 점입니다.

이는 위험도를 줄이면서 현실적인 상용화 속도를 높이기 위한 선택으로 보입니다.

딥마인드는 웹 브라우저 영역에서의 완성도와 속도가 경쟁 모델보다 월등하다고 강조했습니다.

7. 가격 정책 – Gemini 2.5 Pro와 동일, 무료 없음

Computer Use는 현재 Google AI Studio와 Vertex AI에서 개발자용 프리뷰로 제공됩니다.

가격 구조는 Gemini 2.5 Pro와 동일한 토큰 기반 과금제입니다.

| 구분 | 입력 토큰 | 출력 토큰 |

| 200k 이하 프롬프트 | $1.25 / 1M tokens | $10 / 1M tokens |

| 200k 이상 프롬프트 | $2.50 / 1M tokens | $15 / 1M tokens |

차이점은 단 하나, 무료 체험(Free Tier)이 없다는 것입니다.

즉, Computer Use는 바로 유료 모델로 시작합니다.

8. 디지털맨땅이의 관찰 – AI가 진짜 일하기 시작했다

AI가 이제 정보를 읽는 존재에서 직접 일을 하는 존재로 바뀌기 시작했어요.

예를 들어, Browserbase나 Make 같은 자동화 툴과 연결하면

AI가 스스로 웹사이트에 들어가서 양식을 채우고, 버튼을 클릭하고, 결과를 정리해서 보고서 형태로 넘겨줄 수 있습니다.

즉, 우리가 매일 반복해서 하던 클릭하고 복사하는 일을 AI가 대신 처리해주는 첫 단계가 열린 거예요.

딥마인드는 아직 조심스럽게 실험하고 있지만, 방향성은 분명합니다.

이제 AI는 말로 답하는 도우미가 아니라, 직접 움직이면서 결과를 만들어내는 주체가 되어가고 있습니다.

👉 관련 글

2025.08.31 - [맨땅이의 툴 실험실] - [맨땅툴로그] 구글이 드디어 공개했다, 제미나이 2.5 Flash Image (나노바나나)!

[맨땅툴로그] 구글이 드디어 공개했다, 제미나이 2.5 Flash Image (나노바나나)!

안녕하세요. 디지털맨땅이입니다.며칠 전까지만 해도 나노바나나라는 이름으로 떠돌던 이미지 모델을 사용해봤는데요.그때만 해도 정식으로 출시된 모델이 아니었고,이런 저런 정황들로 인해

digital-mentang.tistory.com

2025.08.31 - [맨땅이의 부업 실험실] - [부업실험기] Google Sheets + Make, 블로그 자동화 루틴 구축기 (실패담 포함 후기)

[부업실험기] Google Sheets + Make, 블로그 자동화 루틴 구축기 (실패담 포함 후기)

안녕하세요. 디지털맨땅이입니다.오늘은 제가 직접 부딪혀본 블로그 자동화 루틴 구축기를 공유해보려 합니다. 저는 평소에 글감을 뽑고, 글을 쓰고, 이미지를 만들고, 발행하는 과정을 매번 수

digital-mentang.tistory.com

2025.09.14 - [맨땅이의 AI 뉴스룸] - [AI뉴스룸] 9월 둘째주: 챗GPT와 구글 업데이트, 음성 기능 대폭 확장

'AI 뉴스룸' 카테고리의 다른 글

| 구글 제미나이 3.1 프로(Gemini 3.1 Pro) 발표 - 고난도 추론 모델로 방향 전환 (0) | 2026.02.22 |

|---|---|

| [AI뉴스룸] 9월 둘째주: 챗GPT와 구글 업데이트, 음성 기능 대폭 확장 (2) | 2025.09.16 |

| [AI뉴스룸] 구글 제미나이, 무료 사용량 '하루 5회' 제한…본격 유료화 신호탄 (3) | 2025.09.12 |

| [AI뉴스룸] OpenAI, 브로드컴과 손잡고 2026년 자체 AI 칩 양산 계획 (3) | 2025.09.08 |

| [AI뉴스룸] 9월 첫째주: Gemini·Veo·Hailuo, 놓치면 아까운 3가지 변화 (4) | 2025.09.02 |